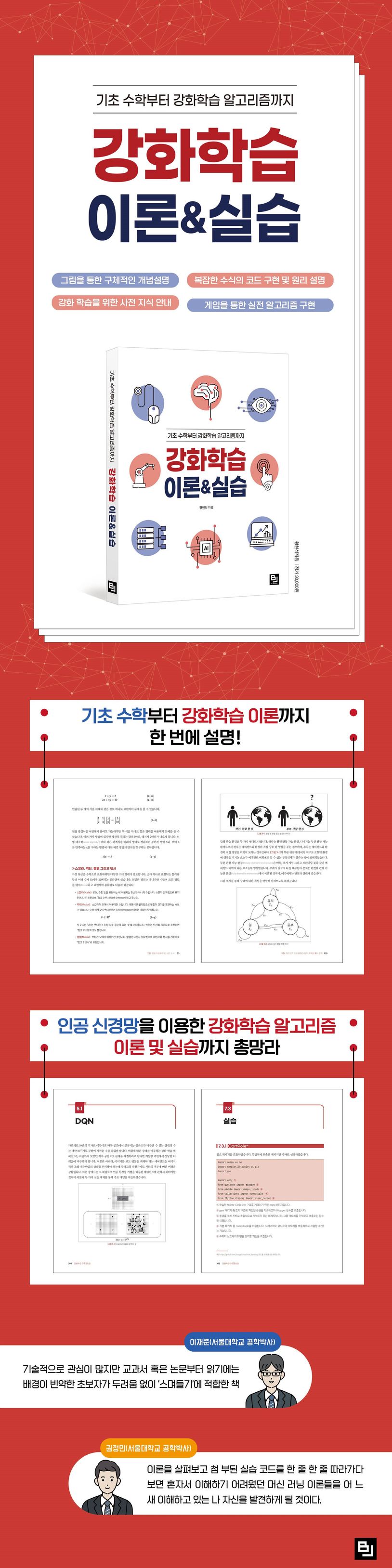

강화학습 이론&실습

도서+교보Only(교보배송)을 함께 15,000원 이상 구매 시 무료배송

15,000원 미만 시 2,500원 배송비 부과

20,000원 미만 시 2,500원 배송비 부과

15,000원 미만 시 2,500원 배송비 부과

1Box 기준 : 도서 10권

로그아웃 : '서울시 종로구 종로1' 주소 기준

해외주문/바로드림/제휴사주문/업체배송건의 경우 1+1 증정상품이 발송되지 않습니다.

패키지

북카드

키워드 Pick

키워드 Pick 안내

관심 키워드를 주제로 다른 연관 도서를 다양하게 찾아 볼 수 있는 서비스로, 클릭 시 관심 키워드를 주제로 한 다양한 책으로 이동할 수 있습니다.

키워드는 최근 많이 찾는 순으로 정렬됩니다.

책 소개

이 책이 속한 분야

- 국내도서 > 컴퓨터/IT > 컴퓨터공학 > 자료구조/알고리즘

- 국내도서 > 컴퓨터/IT > 컴퓨터공학 > 인공지능 > 인공지능일반

- 국내도서 > 컴퓨터/IT > 대학교재

- 국내도서 > 대학교재 > 컴퓨터

작가정보

부산대학교에서 자연과학을 공부하고 서울대학교에서 계산과학 분야로 전공을 바꾸어 공학석사 학위를 취득했다. 공식 교과과정에서 편미분 방정식을 푸는 방식을 배울 때 대학원 시절 동안 옆자리에 앉았던 동기가 인공지능을 공부하는 것을 보고 따라서 머신러닝을 조금씩 독학하기 시작했다. 머신러닝 분야 중 게임을 스스로 플레이 하는 인공지능을 보고 강화학습에 가장 큰 흥미를 느낀 뒤 취미 삼아 이론을 공부하고 개념을 구현하는 데 시간을 많이 보냈다. 어쩌다 보니 현재 인공지능 알고리즘을 적용하는 반도체 모델링을 타겟으로 하는 회사에서 인공지능을 전자회로 시뮬레이터에 접목하는 업무를 맡고 있다.

목차

- 프롤로그

1. 환경 설정

1.1 윈도우 버전

1.2 리눅스 버전

2. 강화 학습을 위한 사전 지식

2.1 머신 러닝과 강화 학습

2.1.1 머신 러닝

2.1.2 강화 학습

2.2 기초 수학

2.2.1 기초 선형 대수

2.2.2 기초 미분과 적분

2.2.3 기초 확률 통계

2.3 최적화

2.3.1 뉴턴-랩슨법(Newton-Raphson method)

2.3.2 경사 하강법(Gradient descent method)

2.4 목적 함수

2.4.1 최소 제곱

2.4.2 확률 엔트로피와 쿨백-라이블러 발산

2.5 인공 신경망

2.5.1 신호 전·후 처리

2.5.2 순방향 전파

2.5.3 역방향 전파

2.6 초간단 파이토치 튜토리얼

2.6.1 MNIST

2.6.2 회귀 분석

2.7 매개 변수 탐색법

2.7.1 격자 탐색법(Grid search)

2.7.2 베이지안 탐색법(Bayesian optimization)

3. 마르코프 의사 결정과 동적 계획법 풀이 전략

3.1 마르코프 의사 결정

3.2 동적 계획법

3.3 [실습] 잭의 렌터카 업체 운영 전략 - 동적 계획법을 이용한 마르코프 의사 결정

4. 밸만 방정식부터 강화 학습까지

4.1 몬테-카를로 추정법

4.2 시간차 학습

4.2.1 TD(0)

4.2.2 TD(λ)

4.3 Monte-Carlo vs Temporal Difference

4.4 에이전트 학습

4.4.1 SARSA

4.4.2 Q-learning

4.4.3 실습

5. Q-함수는 신경망에 맡긴다 - DQN

5.1 DQN 208

5.1.1 이론 209

5.1.2 실습 219

5.2 파생 알고리즘 256

5.2.1 DDQN 256

5.2.2 PER 260

6. 즉각적인 학습이 필요할 때 - Policy gradient

6.1 Actor-Critic

6.1.1 이론

6.1.2 실습

6.2 파생 알고리즘

6.2.1 Asynchronous Advantage Actor-Critic

6.2.2 LSTM-Based Advantage Actor-Critic

6.2.3 [고급] Trust Region Policy Optimization

6.2.4 [고급] Proximal Policy Optimization

7. 탐험의 전략 - Model based learning

7.1 사전 지식 - 밴딧 모델

7.2 이론 - Monte-Carlo Tree Search

7.3 실습

7.3.1 CartPole

7.3.2 Tic-Tac-Toe

찾아보기

추천사

-

강화 학습(RL)은 머신 러닝(ML)의 가장 핵심적인 알고리즘으로, AI 분야에 혁명을 가져온2016년 AlphaGo와 이듬해 AlphaZero 또 2023년 ChatGPT에서도 RL이 적용되어 가장 각광 받는 기술로 여겨지고 있다. 실제로 RL을 활용하여 국내 산업체에서도 각종 게임, 제어 시스템,자율 주행차, 질병 예측 등에서 활발히 연구되고 있다. 강화 학습 전문가에 대한 수요는 앞으로도 높을 것으로 보이나 전문적으로 트레이닝을 받은 엔지니어는 턱없이 부족한 상황이다. 황현석 연구원의 “강화학습 이론&실습 - 기초 수학부터 강화학습 알고리즘까지”는 기초 ML부터Deep RL까지 혼자서도 충분히 따라갈 수 있도록 쉽게 쓰여져 취업 준비생부터 인공지능 대학원에 따로 시간을 투자할 수 없는 현업 엔지니어가 역량 개발을 하기에 혼자서도 학습할 수 있도록 쓰여졌다. 이 책을 이해하면 최신 RL 연구 논문들 (World models, Continual RL, MetaRL, Multi-task RL 등)을 혼자서도 follow-up 스터디하며 응용할 수 있으리라 믿어 의심치않는다. RL에 대한 개념을 잡고 실무 예제를 통해 빠르게 감각을 익히기에는 리처드 S. 서튼의 교과서보다 이 책이 더 적합하다고 생각한다.

출판사 서평

“데이터 분석에 의존한 머신러닝은 이제 그만!”

『강화학습 이론&실습』이 책은 아직도 인공지능이 적용되지 못 한 산업에서 기술을 적용할 가능성을 제안하는 도서이다. 이 책이면 인간보다 주어진 환경에 더 잘 적응하는 인공지능의 개념을 공부하여 나만의 인공지능을 만드는 기술에 대해서 배울 수 있다.

기본정보

| ISBN | 9791165922450 |

|---|---|

| 발행(출시)일자 | 2023년 10월 04일 |

| 쪽수 | 392쪽 |

| 크기 |

188 * 245

* 27

mm

/ 901 g

|

| 총권수 | 1권 |

Klover

e교환권은 적립 일로부터 180일 동안 사용 가능합니다.

리워드는 작성 후 다음 날 제공되며, 발송 전 작성 시 발송 완료 후 익일 제공됩니다.

리워드는 리뷰 종류별로 구매한 아이디당 한 상품에 최초 1회 작성 건들에 대해서만 제공됩니다.

판매가 1,000원 미만 도서의 경우 리워드 지급 대상에서 제외됩니다.

일부 타인의 권리를 침해하거나 불편을 끼치는 것을 방지하기 위해 아래에 해당하는 Klover 리뷰는 별도의 통보 없이 삭제될 수 있습니다.

- 도서나 타인에 대해 근거 없이 비방을 하거나 타인의 명예를 훼손할 수 있는 리뷰

- 도서와 무관한 내용의 리뷰

- 인신공격이나 욕설, 비속어, 혐오발언이 개재된 리뷰

- 의성어나 의태어 등 내용의 의미가 없는 리뷰

리뷰는 1인이 중복으로 작성하실 수는 있지만, 평점계산은 가장 최근에 남긴 1건의 리뷰만 반영됩니다.

구매 후 리뷰 작성 시, e교환권 200원 적립

문장수집

e교환권은 적립 일로부터 180일 동안 사용 가능합니다. 리워드는 작성 후 다음 날 제공되며, 발송 전 작성 시 발송 완료 후 익일 제공됩니다.

리워드는 한 상품에 최초 1회만 제공됩니다.

주문취소/반품/절판/품절 시 리워드 대상에서 제외됩니다.

구매 후 리뷰 작성 시, e교환권 100원 적립